Definicja, jak to często bywa w życiu, jest bardzo prosta: źródło napięcia odniesienia ma generować dokładne napięcie wyjściowe dla układu analogowego (lub analogowo-cyfrowego). Wszyscy wiedzą, że powinno być w miarę możliwości niezależne od wahań napięcia zasilania, prądu obciążenia czy też zmian temperatury. Taka niewzruszona ostoja analogowej precyzji jest oczywiście nieistniejącym ideałem, do którego rzeczywiste układy tylko próbują się zbliżyć. Dlatego dobór źródła napięcia odniesienia (zwykle określanego skrótem VREF lub VR) nie polega po prostu na znalezieniu elementu o najlepszej dokładności, lecz na dopasowaniu architektury i parametrów do konkretnego zastosowania. Inne cechy będą istotne w 12-bitowym czujniku bateryjnym, inne w precyzyjnym kalibratorze mającym zastosowanie w laboratoryjnych multimetrach o rozdzielczości 6,5 cyfry, a jeszcze inne w wielokanałowym urządzeniu przemysłowym pracującym w szerokim zakresie temperatur. Za wyśrubowanymi parametrami technicznymi podąża jeszcze jedna liczba: cena. Jeżeli zbierzemy wszystkie wymogi stawiane scalonemu źródłu napięcia odniesienia, bardzo szybko może wyjść na jaw przykry dysonans: dokładnie i stabilnie to najczęściej bardzo drogo, stabilnie i energooszczędnie często nie oznacza dokładnie, a kompaktowo i wydajnie zwykle nie będzie oznaczało precyzyjnie. Dokładnie tak, jak w kultowym monologu Piotra Bałtroczyka, w którym pewien jegomość, zapytany: „Gdzie o tej porze można zjeść szybko, smacznie i tanio?” odpowiedział: „Młodzieńcze, pytasz o trzy różne lokale!”.

Struktury i technologie

Już na poziomie architektury układowej źródła odniesienia dzielą się na dwa podstawowe typy funkcjonalne: szeregowe (series) i równoległe, określane zwykle mianem shunt. Pod względem aplikacyjnym źródła szeregowe przypominają precyzyjne stabilizatory liniowe o bardzo małej wydajności prądowej (rysunek 1).

Podobnie jak stabilizatory wymagają one bowiem zasilania o napięciu przewyższającym napięcie wyjściowe (nominalne) i oddają prąd do obciążenia przez element regulacyjny (tranzystor bipolarny lub MOSFET), szeregowo włączony do układu. Zaletą takiego rozwiązania jest zwykle większa sprawność, czyli mniejsze straty mocy, a także łatwiejsza współpraca ze zmiennym obciążeniem, w porównaniu do stabilizatorów równoległych.

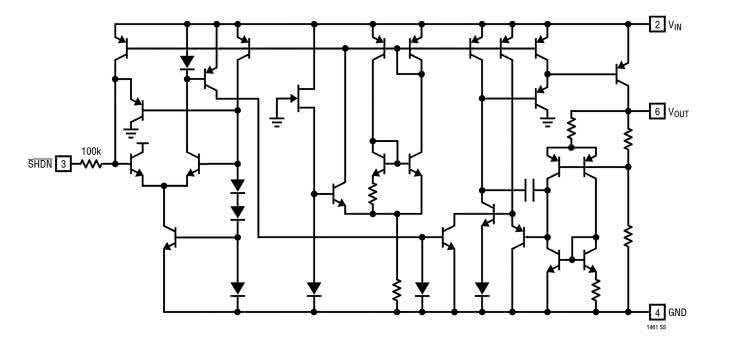

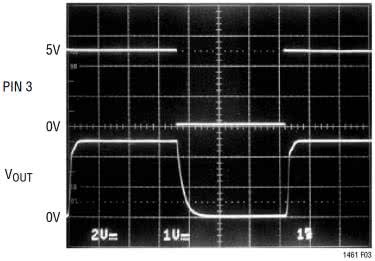

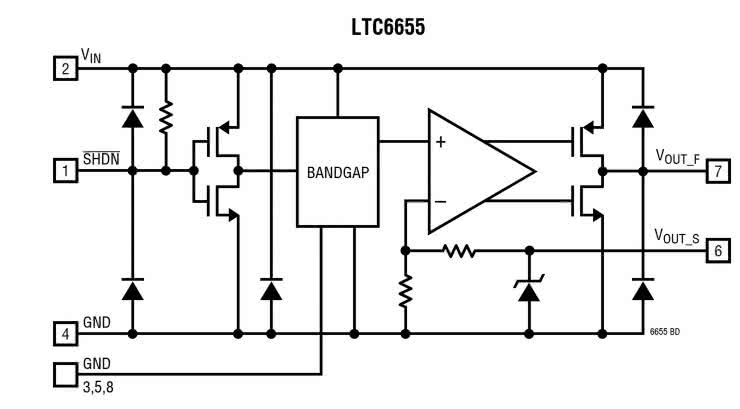

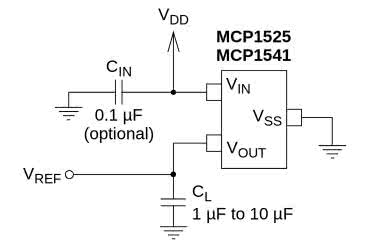

Układy te w większości przypadków (poza wyspecjalizowanymi modelami, które zwykle są też dość kosztowne) nie wymagają zbyt dużej liczby elementów zewnętrznych: najczęściej wystarczy para kondensatorów odsprzęgających, po jednym na wejściu oraz na wyjściu układu (rysunek 2). Minimalna jest także liczba używanych wyprowadzeń: w wielu przypadkach wyprowadzone są tylko trzy piny (wejście, masa i wyjście), a dodatkowe linie mogą służyć np. do wyłączania układu w celu redukcji poboru prądu (rysunki 3 i 4).

Bardziej zaawansowane modele mogą mieć dodatkowo wejście sense, którego celem jest bardzo precyzyjny pomiar rzeczywistego napięcia wyjściowego (podobnie, jak w przypadku lepszych zasilaczy laboratoryjnych) – patrz rysunek 5.

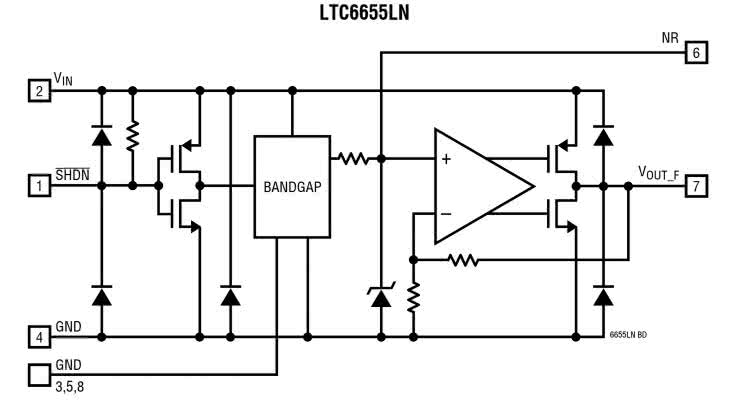

Czasem można spotkać się z jeszcze innymi liniami: przykładowo w przypadku układu LTC6655LN dostępny jest pin NR (ang. Noise Reduction), do którego należy podłączyć kondensator filtrujący napięcie pochodzące z wbudowanego wzorca napięcia i podawane – poprzez szeregowy rezystor – na wejście nieodwracające wzmacniacza błędu (rysunek 6).

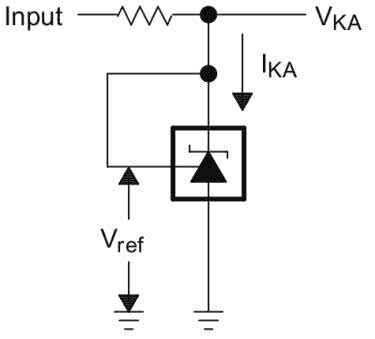

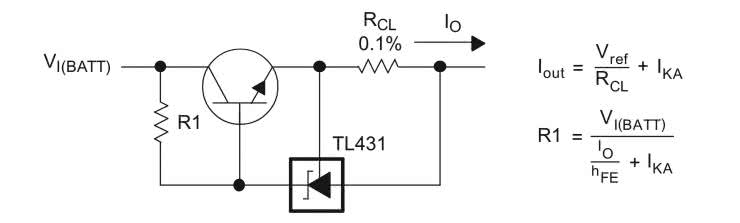

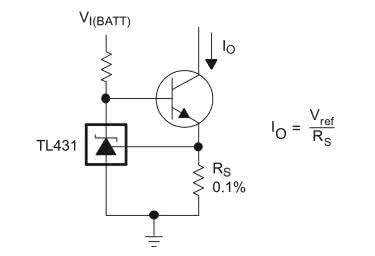

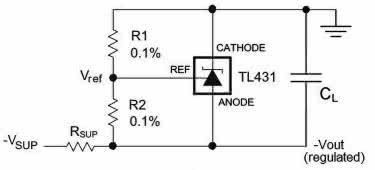

Źródła typu shunt działają w sposób zbliżony do precyzyjnej diody Zenera: utrzymują stałe napięcie, odprowadzając nadmiar prądu z rezystora ograniczającego (RS) do masy układu (rysunek 7).

Są bardzo elastyczne pod względem topologii, mogą bowiem pracować w różnych konfiguracjach układowych. Za ich pomocą można z łatwością budować referencje dodatnie, ujemne i „pływające”, ale trzeba pamiętać, że całkowity prąd zasilający musi zawsze pokrywać zarówno minimalny prąd pracy samego źródła, jak i maksymalny prąd pobierany przez obciążenie. Elastyczność aplikacyjna wynika z prostego faktu: najprostszy przykład użycia źródła typu shunt – np. nieśmiertelnego TL431 – sprowadza ów układ do postaci dwójnika, który nie ma zdefiniowanej ani masy, ani źródła zasilania (w odróżnieniu od szeregowych źródeł napięcia odniesienia, które – podobnie jak stabilizatory – mają ściśle określoną topologię układową). Kilka przykładowych realizacji pokazano na rysunkach 8...10.

Wadą źródeł równoległych jest jednak dość mała wydajność prądowa tego typu rozwiązań, a nade wszystko – znaczący pobór mocy w typowych warunkach pracy. Trzeba bowiem pamiętać, że im z większym obciążeniem ma sobie poradzić źródło, tym mniejsza powinna być wartość rezystora ograniczającego. Z drugiej strony, przy braku obciążenia niewielka rezystancja RS wymusi spore straty mocy – dość powiedzieć, że właśnie z takich aplikacji wzięła się potrzeba produkcji diod Zenera o mocach rzędu kilku watów i więcej.

Za funkcjonalnym podziałem na źródła szeregowe i równoległe kryje się drugi, ważniejszy z punktu widzenia parametrów użytkowych, podział na architektury – można tu wyróżnić: proste referencje diodowe, źródła typu bandgap i buried Zener oraz nowsze rozwiązania pokrewne, w tym układy typu XFET czy tzw. floating-gate analog. W praktyce to właśnie ten podział w dużej mierze decyduje o osiągach w zakresie dryfu, szumów własnych, prądu zasilania, napięcia pracy oraz – rzecz jasna – o cenie komponentu.

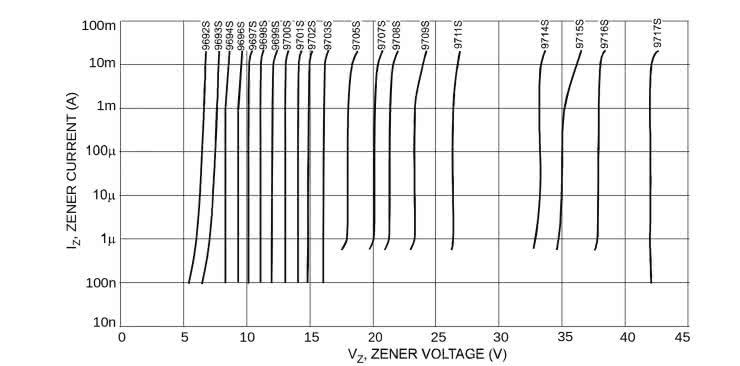

Najprostsze i historycznie najbardziej popularne są źródła diodowe, w tym diody Zenera. Klasyczna dioda krzemowa włączona w kierunku przewodzenia ma stosunkowo dobrze określoną zależność napięcia (VF) od prądu (IF), ale charakterystyka ta silnie zależy od temperatury złącza p-n, co jest powszechnie wykorzystywane w budowie prostych czujników temperatury. Każda dioda Zenera pracująca w kierunku zaporowym daje napięcie znacznie stabilniejsze (a więc bardziej użyteczne jako punkt odniesienia – patrz rysunek 11), jednak ma swój własny współczynnik temperaturowy, a ponadto bywa źródłem znacznych szumów.

Już w starszych konstrukcjach stosowano kombinację dwóch zjawisk o przeciwnych współczynnikach temperaturowych, aby uzyskać częściową kompensację termiczną na zasadzie wzajemnego znoszenia się dryfów termicznych. Tak powstały skompensowane diody odniesienia, ale ich użyteczność ograniczały z kolei: dość wysokie napięcie zasilania wymagane do poprawnej pracy, konieczność ostrożnego doboru prądu polaryzacji i raczej przeciętna elastyczność aplikacyjna. Dzisiaj dyskretne „Zenery” stosuje się nadal tam, gdzie liczy się prostota i ekstremalnie niski koszt, lecz w systemach precyzyjnych prawie zawsze ustępują one nowocześniejszym rozwiązaniom scalonym.

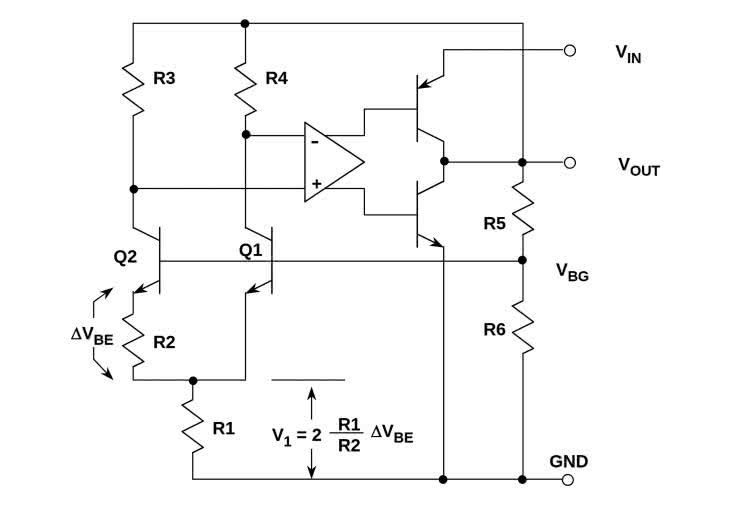

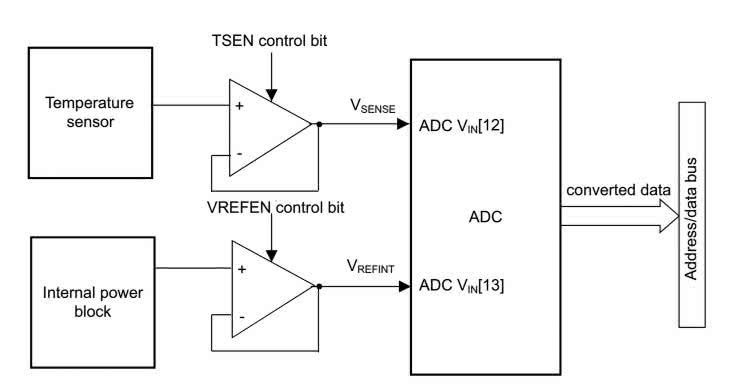

Prawdziwym przełomem w elektronice analogowej było wprowadzenie źródeł typu bandgap. Ich idea wynika z faktu, że napięcie złącza baza-emiter tranzystora bipolarnego ma ujemny współczynnik temperaturowy (tak samo, jak zwykła dioda krzemowa), natomiast odpowiednio wygenerowane napięcie proporcjonalne do temperatury bezwzględnej (określane mianem PTAT – ang. Proportional To Absolute Temperature), ma współczynnik dodatni. Sumując oba składniki w odpowiedniej proporcji, można otrzymać napięcie wyjściowe o minimalnym dryfie temperaturowym, zbliżone do napięcia przerwy energetycznej krzemu (około 1,2 V). Z układowego punktu widzenia idea źródła typu bandgap jest bardzo atrakcyjna: z uwagi na prostotę konstrukcyjną dobrze nadaje się do integracji w większych układach analogowych, działa przy niskim napięciu, może pracować przy znikomym prądzie zasilania, a w dodatku umożliwia uniknięcie stosowania zaszumionych struktur Zenera. Z tego względu stanowi ono serce znakomitej większości współczesnych, scalonych źródeł napięcia odniesienia, zarówno szeregowych, jak i równoległych.

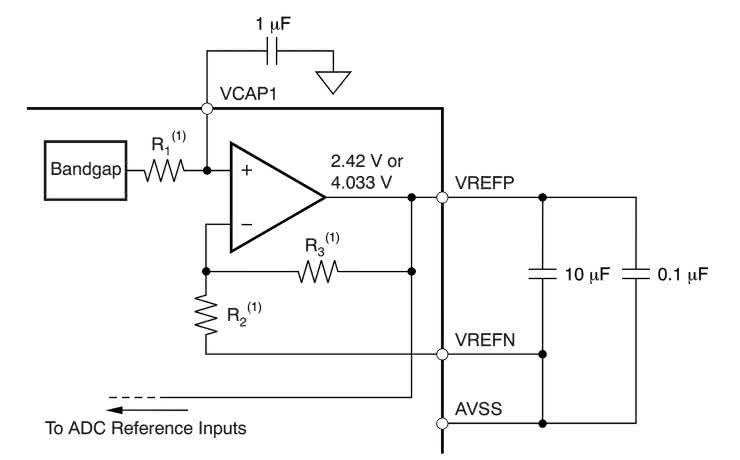

Wzorce bandgap można znaleźć w niezliczonych układach scalonych – chociażby w mikrokontrolerach (rysunek 12), przetwornikach ADC i DAC z wewnętrzną referencją, w precyzyjnych front-endach analogowych (AFE – przykład na rysunku 13) i setkach innych układów, które wymagają stabilnego wzorca. Źródła typu bandgap dobrze wpasowują się bowiem we współczesne trendy widoczne w układach analogowych oraz mieszanych (mixed-signal): bez problemu generują napięcia nawet znacznie poniżej 5 V, pobierają niski prąd spoczynkowy i wykazują dryf temperaturowy rzędu 20 ppm/°C (lub mniejszy).

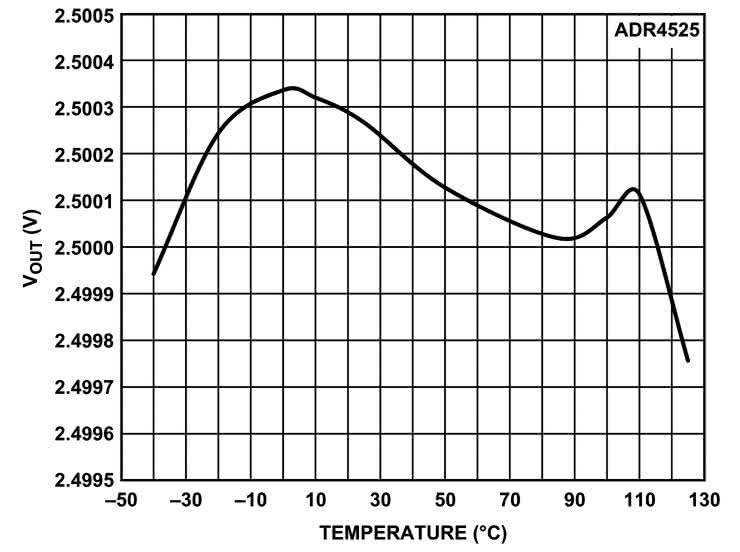

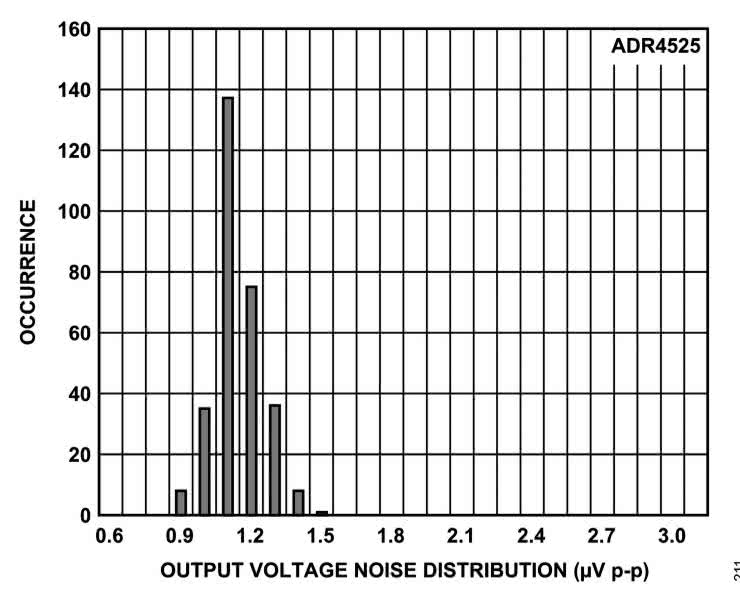

Warto w tym momencie zatrzymać się na chwilę przy ostatnim z wymienionych parametrów, czyli dryfie temperaturowym. Bandgap jest rozwiązaniem bardzo uniwersalnym, ale nie należy z góry zakładać, że każde źródło tego typu będzie miało zbliżone osiągi w zakresie stabilności. Współczesne układy z zaawansowaną kompensacją charakterystyki temperaturowej osiągają parametry jeszcze niedawno kojarzone tylko z nieporównanie lepszymi źródłami typu buried Zener. Godnym reprezentantem wysokiej klasy bandgapów jest rodzina ADR45xx firmy Analog Devices (rysunki 14 i 15) – w przypadku najlepszego z należących do niej układów producent podaje maksymalny współczynnik temperaturowy 0,8 ppm/°C, błąd początkowy do ±0,02% oraz szum w paśmie 0,1...10 Hz rzędu 1 μV pk-pk (w przypadku wariantu o napięciu nominalnym 2,048 V). Jest to jeden z ciekawszych przykładów pokazujących, jak daleko dopracowano nowoczesne źródła niskonapięciowe, a zarazem energooszczędne – maksymalny pobór prądu nieobciążonego źródła z serii ADR45xx to jedynie 950 μA.

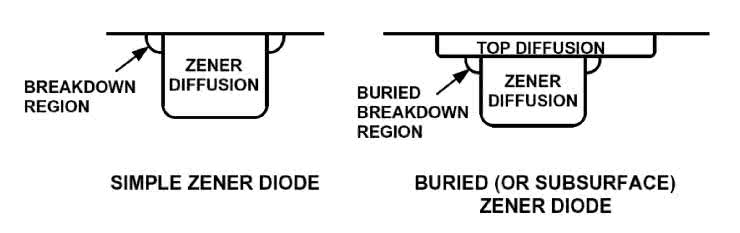

Alternatywą dla bandgapu w układach najwyższej klasy pozostaje wspomniana wyżej konstrukcja nazywana buried Zener, czyli złącze lawinowe uformowane w strukturze półprzewodnikowej tak, aby ograniczyć wpływ zjawisk powierzchniowych (rysunek 16). Tego typu źródło pracuje zwykle przy wyższych napięciach wewnętrznych i większym prądzie, ale odwdzięcza się bardzo dobrymi parametrami szumowymi, znakomitą stabilnością długoczasową i niskim dryfem termicznym. W praktyce właśnie dlatego precyzyjne multimetry, kalibratory, laboratoryjne wzorce i zaawansowane systemy akwizycji danych tak długo opierały się właśnie na buried Zenerach.

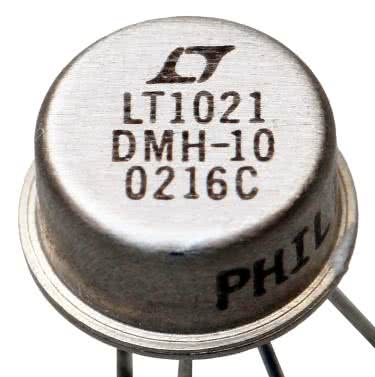

Dobrą ilustracją tej klasy jest układ LT1021 (fotografia 1). Choć jest to konstrukcja od dawna obecna na rynku, nadal pozostaje czytelnym punktem odniesienia dla rozważań aplikacyjnych. Producent deklaruje maksymalny dryf 5 ppm/°C, szum poniżej 1 ppm pk-pk

w paśmie 0,1...10 Hz oraz tłumienie tętnień napięcia zasilającego przekraczające 100 dB. Takie parametry mają jednak swoją cenę: struktura buried Zener potrzebuje zwykle większego napięcia zasilania i pobiera wyższy prąd spoczynkowy niż prosty bandgap. W nowoczesnym sprzęcie zasilanym napięciem 3,3 V będą to w większości przypadków ograniczenia nie do zaakceptowania.

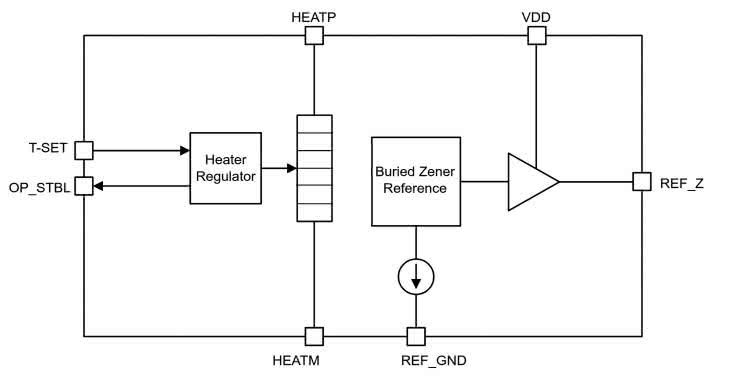

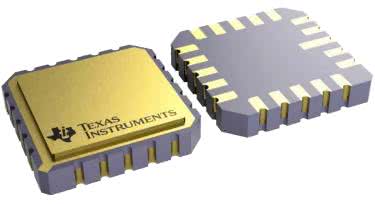

Nowsze układy zostawiają poprzednie generacje źródeł napięcia odniesienia daleko w tyle pod względem zarówno parametrów dokładności i stabilności, jak i poziomu szumów własnych. Stosunkowo niedawno, bo zaledwie półtora roku przed momentem pisania niniejszego artykułu, na rynek weszły źródła z rodziny REF80 (rysunek 17) – najnowszej generacji układy oparte na technologii buried Zener, które oferują aż 100-krotnie mniejszy dryf termiczny (0,05 ppm/°C), stabilność długoczasową na poziomie 0,3 ppm (w przedziale 1000...5000 h pracy), zaś szum w paśmie 0,1...10 Hz to zaledwie 0,12 ppm pk-pk.

Jak udało się to osiągnąć? Producent zastosował tutaj technikę znaną z wysoce stabilnych oscylatorów kwarcowych stabilizowanych termicznie (OCXO), wbudowując w strukturę układu... miniaturową grzałkę. Takie rozwiązanie oczywiście drastycznie zwiększa pobór mocy (w fazie rozgrzewania układ pobiera typowo 335 mA), a sam tor analogowy, podobnie jak zresztą obwód grzałki, wymaga zasilania napięciem przynajmniej 10 V. Chyba jednak nikt nie będzie miał mu tego za złe, zważywszy na to, co jest on w stanie zaoferować projektantom najwyższej klasy urządzeń pomiarowych czy kalibratorów. Cena? Za jedno takie technologiczne cacko (fotografia 2) trzeba w chwili pisania niniejszego artykułu zapłacić nieco ponad 360 złotych. O ile oczywiście potrzebujemy od razu partię 250 egzemplarzy.

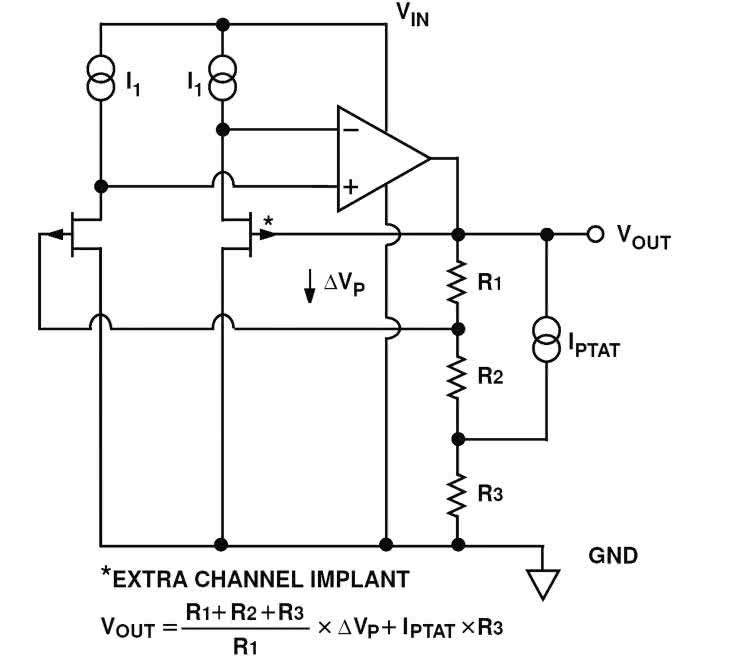

Pomiędzy dwoma opisanymi wyżej, głównymi technologiami pojawiły się architektury pośrednie i pochodne. Dokumentacja Analog Devices opisuje między innymi referencje XFET (ang. eXtra implanted FET), oparte na właściwościach tranzystorów JFET – rysunek 18 – i zaprojektowane tak, by połączyć część zalet struktur typu bandgap oraz buried Zener: relatywnie niskie napięcie pracy, niewielki pobór prądu, mały dryf i mniejszy szum niż w typowych, prostych bandgapach. Przykład? Proszę bardzo – układ ADR290 (dziś już wycofany z oferty) mógł być zasilany napięciem rzędu 2,7 V, generując przy tym stabilne napięcie wyjściowe równe 2,048 V o współczynniku termicznym 8 ppm/°C i pobierając zaledwie 12 μA prądu zasilania. Dokładność początkowa wynosiła natomiast ±2 mV, czyli około 0,1% – owszem, można lepiej, ale w wielu przypadkach ważniejsza jest stabilność odniesienia, niż bezwzględna dokładność „prosto z fabryki”.

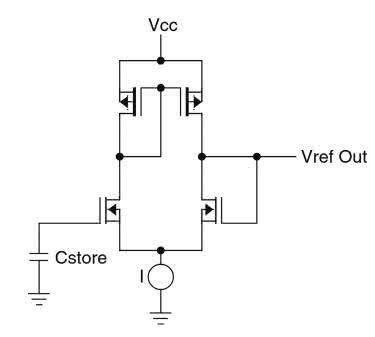

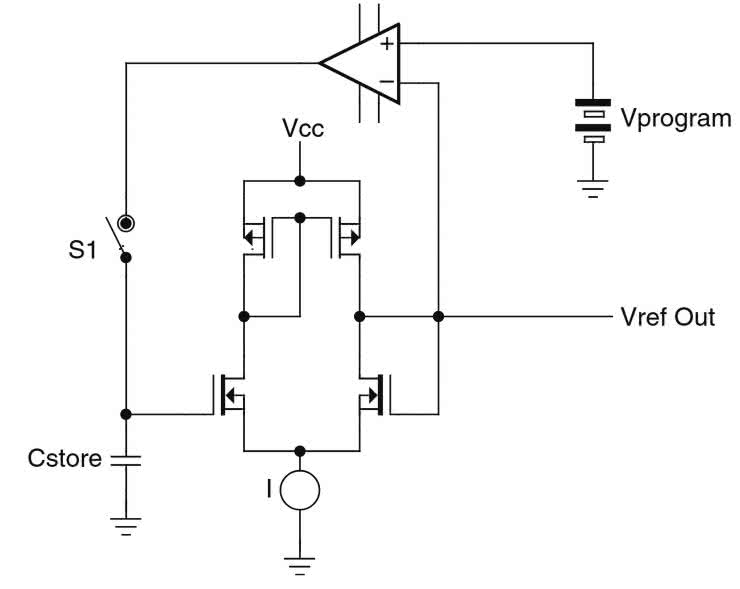

Firma Intersil opracowała kiedyś bardzo interesującą technologię o nazwie floating-gate analog (FGA), kładąc nacisk na bardzo niski pobór prądu, bardzo mały dryf i dobrą dokładność początkową. W opisach literaturowych pojawiają się zresztą konkretne liczby: dryf temperaturowy 1 ppm/°C, dokładność początkowa 0,01% i pobór prądu poniżej 1 μA. Sama technika realizacji tego rodzaju układów jest niezwykle ciekawa, gdyż całkowicie porzuca podejście polegające na oparciu wzorca na specyficznych parametrach elektrycznych półprzewodnika. Tutaj źródłem wartości referencyjnej nie jest bowiem sama przerwa energetyczna czy napięcie przebicia, ale... ładunek „zapamiętany” w specjalnej, odizolowanej od reszty układu komórce analogowej pamięci (rysunek 19).

Wynika z tego bardzo istotny fakt: skoro ładunek wstrzykiwany do tego specyficznego kondensatora jest programowany na etapie produkcji, to można go... dostosowywać w szerokim zakresie! Za buforowanie tego delikatnego potencjału odpowiada zintegrowany wzmacniacz oparty na tranzystorach FET, zaś wspomniane już programowanie umożliwia specjalny klucz półprzewodnikowy. Takie rozwiązanie słusznie kojarzy się z pamięcią EEPROM, zresztą literatura bezpośrednio używa właśnie takiej nazwy do opisu omawianej technologii. W źródłach można znaleźć informacje, że trwałość układów typu floating-gate analog (tzn. czas przechowywania ładunku bez żadnej mierzalnej jego utraty) wynosi minimum 10 lat. Jako przykład obecnej na rynku rodziny źródeł opartych na technologii FGA może posłużyć seria ISL21080 marki Renesas. Choć podstawowe parametry tych układów są raczej dość przeciętne (dryf 50 ppm/°C, dokładność bazowa rzędu 0,2%, szumy 40 μV pk-pk), to unikalną cechą jest niezwykle niski pobór prądu, który typowo wynosi 310 nA (!). Takie rozwiązanie nie nadaje się zatem do poważniejszych przyrządów pomiarowych, ale w układach ekstremalnie energooszczędnych (np. bateryjnych sensorach IoT) może się okazać niezastąpione.

Jak widać, wprowadzenie nowych rodzajów źródeł napięcia odniesienia nie oznacza automatycznie, że każdy taki układ zastąpi klasyczne, nieco leciwe już źródło buried Zener (czy lepszej klasy źródło typu bandgap) w aparaturze o najwyższych wymogach metrologicznych. Warto jednak pamiętać, że prosta, wręcz stereotypowa klasyfikacja typu: bandgap = „tanio, przeciętnie”, buried Zener = „perfekcyjnie, ale drogo” jest dziś zdecydowanie zbyt daleko idącym uproszczeniem.

Parametry pod lupą

Po wyborze architektury zaczyna się zasadnicza część pracy konstruktora: interpretacja parametrów katalogowych. Pierwszym z nich jest dokładność bazowa czy też początkowa, określana w notach katalogowych jako initial accuracy. Jest to nic innego, jak tylko błąd napięcia wyjściowego mierzony zwykle po ustaleniu temperatury do wartości pokojowej i to bez dodatkowej kalibracji napięcia (która jest możliwa w przypadku niektórych źródeł za sprawą końcówki TRIM).

Często właśnie ten parametr przyciąga uwagę najbardziej, bo łatwo go zinterpretować: ±0,1%, ±0,05%, ±0,02%, ±0,005%... każdy jest w stanie dość szybko odnieść się do swojej intuicji, porównując te liczby chociażby z tolerancją rezystorów. Wiadomo wszak, że dawniej za rezystory precyzyjne uważano te, które miały przynajmniej 1-procentową tolerancję, zaś w dobie powszechnej dostępności elementów SMD o takim rozrzucie rezystancji (i dostępnych w cenach na poziomie ułamka grosza) jako „precyzyjne” należy raczej uznawać komponenty o tolerancji 0,1% lub lepszej. Warto jednak pamiętać, że w wielu systemach sam błąd początkowy jest najmniej groźnym składnikiem całego obrazu sprawy. Jeżeli tylko urządzenie jest wyposażone w procedurę kalibracji (chociażby jednopunktowej) podczas produkcji lub uruchomienia, to błąd początkowy można dziecinnie łatwo i bardzo skutecznie skompensować. Nie da się natomiast równie łatwo usunąć szumu, dryfu temperaturowego, histerezy cieplnej czy podatności na wahania napięcia zasilającego. Mało tego – słowo „accuracy” w odniesieniu do wzorców napięcia bywa mylące, bo może znaczyć różne rzeczy w różnych kontekstach. Należy w tym miejscu przypomnieć starą prawdę, którą każdy z nas słyszał na zajęciach z fizyki (czy to w szkole, czy na studiach): dokładność to nie to samo, co precyzja. Dla jasności: precyzja to miara rozrzutu (czy też powtarzalności), zaś dokładność to miara zgodności rzeczywistych wartości z ideałem. Dlatego parametr dokładności bazowej należy traktować jako jeden z elementów budżetu metrologicznego, a nie jego synonim.

W praktyce dokładność bazowa ma największe znaczenie tam, gdzie nie planuje się kalibracji albo gdzie urządzenie ma od razu po włączeniu spełnić określone wymogi dotyczące absolutnego błędu. Dotyczy to choćby prostszych multimetrów ręcznych, przetworników 4...20 mA kalibrowanych fabrycznie, źródeł programowalnych czy systemów rozproszonych, w których koszt kalibracji każdego węzła byłby zbyt duży i bardziej opłaca się zastosować odniesienie o nieco lepszej dokładności. Jeżeli jednak urządzenie ma wewnętrzny wzorzec programowy, tablicę korekcyjną lub może przechodzić okresową kalibrację serwisową, znacznie ważniejsze okazują się powtarzalność (precyzja), dryfy oraz parametry szumowe (określane w odniesieniu do przedziałów widma częstotliwości).

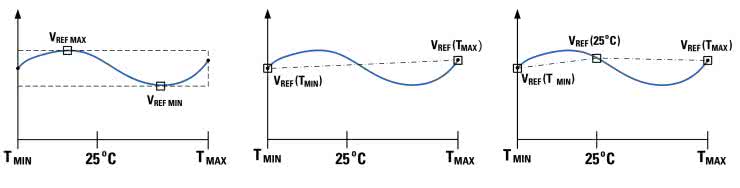

Drugim parametrem, zwykle ważniejszym, jest zatem dryf temperaturowy (ang. temperature coefficient, TC). W kartach katalogowych jest on najczęściej wyrażany w jednostce, która już wielokrotnie przewinęła się w tym artykule, czyli w ppm/°C albo (rzadziej) w mierze bezwzględnej, np. w μV/°C czy mV/°C. Na pierwszy rzut oka ppm/°C wydaje się wartością oczywistą, ale diabeł tkwi w metodzie pomiaru. Producenci stosują różne sposoby wyznaczania TC: metodę pudełkową („box”), metodę nachylenia odcinka i inne (patrz rysunek 21). Dwa układy opisane tym samym parametrem „10 ppm/°C” nie muszą więc zachowywać się identycznie. W praktyce najbezpieczniej patrzeć nie tylko na jedną liczbę, lecz także na wykres VOUT=f(T) oraz noty wyjaśniające metodologię pomiaru. Jeżeli przetwornik pracuje w zakresie 0...50°C, średni dryf określony dla pełnego zakresu roboczego –40...125°C może znacznie zafałszowywać to, co naprawdę zdarzy się w warunkach eksploatacji.

Warto też przeliczać ppm/°C na wartość bezwzględną. Dla VREF=2,5 V dryf 2 ppm/°C oznacza zmianę o 5 μV/°C. Przy 50°C różnicy temperatury daje to 250 μV, czyli 0,01%, oczywiście tylko przy założeniu, że charakterystyka termiczna przebiega w przybliżeniu liniowo, przynajmniej w rozpatrywanym zakresie temperatur pracy. Tak czy inaczej, w systemie 16-bitowym o pełnej skali 2,5 V jeden LSB to około 38 μV, więc sam dryf może w najgorszym wypadku odpowiadać nawet kilku LSB. Im wyższa rozdzielczość i im dłuższy czas pracy bez rekalibracji, tym stabilniejsze temperaturowo źródło jest potrzebne. Nieprzypadkowo w literaturze wiąże się czasem układy typu buried Zener z systemami 14-, 16- czy 24-bitowymi, a prostsze bandgapy raczej z niższymi rozdzielczościami (10...12 bitów). Dziś granice te zatarły się znacznie bardziej niż kiedyś, ale sama logika obliczeń i procesu decyzyjnego pozostaje słuszna.

Trzecim parametrem, często niedoszacowanym, jest szum. Wzorzec jest przecież źródłem napięcia dla toru pomiarowego, więc każdy jego szum bezpośrednio lub pośrednio moduluje wynik przetwornika ADC albo napięcie wyjściowe konwertera DAC. W dokumentacjach spotyka się zwykle dwie miary: szum niskoczęstotliwościowy w paśmie od 0,1 Hz do 10 Hz, podawany najczęściej jako μVpp (czyli jako wartość międzyszczytową, oznaczaną też μV pk-pk) oraz gęstość widmową, zwykle w nV/√Hz, na przykład przy 1 kHz. Obie wielkości opisują inne zjawiska. Wartość μVpp w wąskim, niskim paśmie dobrze pokazuje udział szumu różowego, czyli 1/f; parametr nV/√Hz mówi raczej o szerokopasmowym szumie białym w dalszych częściach widma i pozwala obliczyć przybliżony szum w określonym przedziale pasma użytecznego. Dla wolnych, wysokorozdzielczych przetworników delta-sigma, stosowanych np. do digitalizacji wyników pomiaru mostka tensometrycznego, najistotniejszy bywa pierwszy parametr, dla szybszych SAR-ów i układów z multiplekserami – drugi. Warto też pamiętać, że nierzadko w notach katalogowych można także spotkać pierwszy parametr zapisywany jako μVrms, którego wartość z natury rzeczy będzie niższa (a więc także – pozornie – bardziej atrakcyjna) niż wartość międzyszczytowa – różnica jest dobrze widoczna w dokumentacjach przetworników ADC, w których często można znaleźć obszerne tabele zawierające obydwa parametry (międzyszczytowy i skuteczny), zwykle wraz z ekwiwalentnymi miarami, np. w postaci efektywnej liczby bitów, in. ENOB (które podczas szybkich obliczeń inżynierskich często okazują się bardziej przydatne). Mało tego – niektórzy producenci scalonych źródeł napięcia odniesienia podają trzy wartości: μVpp w paśmie 0,1...10 Hz, μVrms w przedziale 10...1000 Hz oraz nV/√Hz dla zakresu pasma od 1 kHz w górę. Trzeba zatem uważnie studiować dokumentacje i zwracać uwagę na warunki, w których producent uzyskał deklarowane w notach katalogowych wartości.

Tu znów warto uważać na interpretację. Napięcie 1 μVpp dla referencji 2,048 V wygląda znakomicie i rzeczywiście takie liczby oferują dziś najlepsze układy, na przykład ADR45xx w przypadku wariantu 2,048 V. Z kolei w dokumentacji REF50xx-EP firmy TI można znaleźć zapis 3 μVpp/V, co w przypadku wersji 2,5 V przekłada się już na 7,5 μVpp – zamiast różnicy trzykrotnej mamy więc wynik gorszy prawie 8 razy!

Szum referencji trzeba też zawsze odnosić do pasma użytecznego systemu. Jeżeli przetwornik ADC próbkuje szybko, ale dane są później silnie filtrowane i uśredniane cyfrowo, to część szerokopasmowego szumu zostanie skutecznie odrzucona. Nie zniknie jednak niskoczęstotliwościowy szum 1/f i dryf, bo to one zmieniają tło pomiaru w czasie sekund i minut. Stąd spotykana praktyka stosowania specjalnego pinu do wewnętrznego odsprzęgania źródła, do którego dołącza się kondensator obniżający szerokopasmowy szum. Ten sam pin bywa zresztą stosowany także do strojenia (kalibracji), co jest uwidocznione stosowną nazwą takiego wyprowadzenia (np. TRIM/NR). Trzeba jednak pamiętać, że większa pojemność oznacza zwykle także dłuższy rozruch układu.

Kolejnym ważnym parametrem jest stabilność długoczasowa, w anglojęzycznych źródłach określana mianem long-term stability. To jeden z trudniejszych do określenia parametrów, bo użytkownik często spotyka tylko wartość typową np. po 1000 godzinach pracy. Sama definicja nie jest jednolita między producentami, a procesy starzeniowe zależą od technologii, temperatury, naprężeń mechanicznych i historii elementu. Mimo to ów parametr jest krytyczny w aparaturze pracującej miesiącami lub latami bez wzorcowania. Z punktu widzenia konstruktora ważne jest to, że stabilność długoczasowa bywa silnie skorelowana z technologią bazową (np. bandgap, buried Zener, floating-gate analog, etc.), a nawet z rodzajem obudowy układu scalonego. W aparaturze laboratoryjnej nie bez powodu długo utrzymywały się (i wciąż są stosowane) metalowe obudowy hermetyczne.

Z tym zagadnieniem wiąże się zresztą kolejne zagadnienie: histereza cieplna. Nie jest to zwykły dryf, lecz zmiana napięcia po cyklu nagrzewania i chłodzenia. Innymi słowy: dwa pomiary wykonane przy tej samej temperaturze mogą dać różny wynik w zależności od tego, jaką drogą termiczną układ do tej temperatury doszedł. Źródłem tego efektu są naprężenia w strukturze układu i obudowie, rozszerzalność cieplna materiałów oraz relaksacja mechaniczna po zalaniu i montażu. W praktyce parametr ten szczególnie daje o sobie znać w systemach precyzyjnych montowanych na dużych płytach PCB, narażonych na cykle dobowe lub procesy lutowania naprawczego.

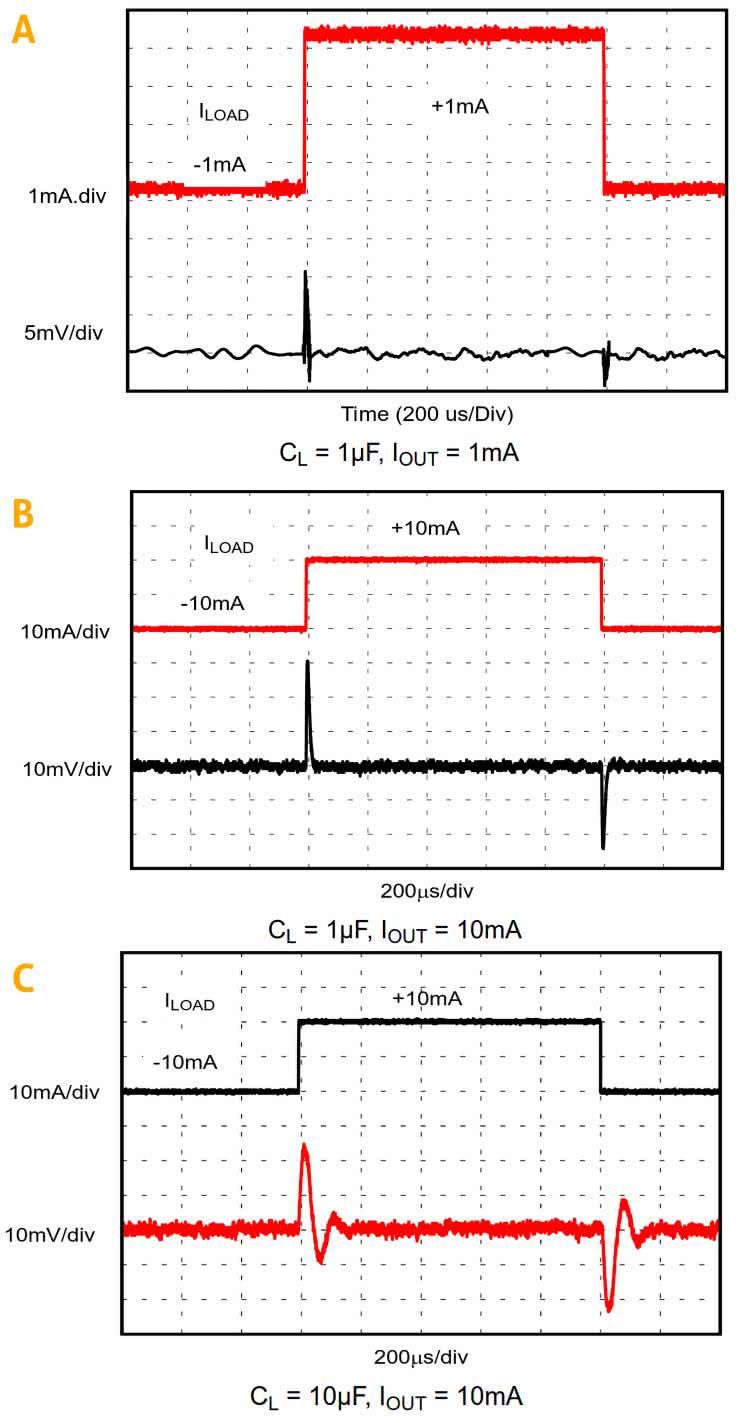

Nie można też pominąć wydajności prądowej i sposobu obciążania wyjścia źródła napięcia odniesienia. Wielu konstruktorów czyta kartę katalogową tak, jakby referencja miała zasilać wyłącznie wysokoimpedancyjne wejścia JFET. Tymczasem nowoczesne przetworniki SAR potrafią pobierać ze wzorca krótkie impulsy prądu związane z ładowaniem wewnętrznych pojemności. Bez lokalnego bufora i dobrze dobranych pojemności odsprzęgających „szarpanie” prądu przez wejście VREFIN konwertera prowadzi do wzrostu błędu przetwarzania, pomimo że stabilność źródła w warunkach (niewielkiego) obciążenia statycznego wciąż jest fantastyczna. Sama informacja, że wyjście danego układu może dostarczyć np. 10 mA prądu nie oznacza jeszcze, że układ poradzi sobie z gwałtownymi pikami prądu o stromym narastaniu, pobieranymi przez „uwieszony” na nim przetwornik lub inny układ analogowy. Odpowiedź skokową źródła można zobaczyć w nocie katalogowej i wygląda ona przeważnie tak, jak na rysunku 22. Trzeba patrzeć także na stabilność powiązaną z zastosowaniem pojemności wyjściowej, odpowiedź skokową i zalecane sposoby połączenia z ADC (np. z dodatkowym buforowaniem lub bez).

W tym miejscu pojawia się też parametr nazywany load regulation. Określa on zmianę napięcia wyjściowego w funkcji prądu obciążenia, zwykle w μV/mA lub ppm/mA. Dla źródła napięcia odniesienia ma ona większe znaczenie, niż mogłoby się wydawać, ponieważ obciążenie wejścia referencyjnego przetwornika nie zawsze jest stałe. Jeżeli do jednego źródła podłączono kilka odbiorników, na przykład przetworniki ADC, DAC i komparator, to ich chwilowe pobory prądu mogą się sumować i modulować wartość napięcia odniesienia. Dlatego w systemach wielokanałowych często stosuje się skrupulatnie dobrany bufor lub wręcz osobne źródła dla poszczególnych bloków funkcjonalnych. Warto zapamiętać, że źródło napięcia odniesienia nie może być traktowane jak studnia bez dna, choć pozorne podobieństwo źródeł szeregowych do poczciwych stabilizatorów liniowych o 10...100-krotnie większej wydajności prądowej mogłoby to sugerować.

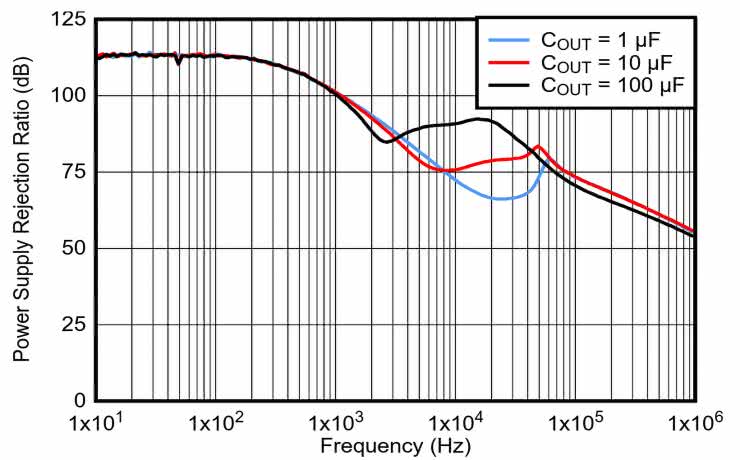

W niektórych aplikacjach równie ważna jest wartość określana line regulation, której zdecydowanie nie należy jednak mylić ze współczynnikiem PSRR (ang. Power Supply Rejection Ratio). Ten pierwszy parametr to nic innego, jak tylko odporność na zmiany napięcia zasilającego, które w jakimś stopniu przenoszą się na wyjście źródła odniesienia. Podstawową jednostką regulacji napięciowej jest μV/V lub ppm/V, ale jej zastosowanie ma sens tylko w warunkach statycznych. Przy wzroście częstotliwości tłumienie wahań na szynie zasilania silnie się pogarsza, co jest zresztą zjawiskiem dobrze znanym ze stabilizatorów liniowych. Producenci ostrzegają, że przy kilkuset kHz tłumienie może spadać o 30...50 dB, dlatego wejście referencji powinno być starannie odsprzęgnięte, co nie powinno zresztą dziwić żadnego praktykującego elektronika. Nie należy jednak pomijać tej kwestii ani traktować jej zbyt pobieżnie, gdyż wiele współczesnych urządzeń zasila źródło napięcia odniesienia z wyjścia przetwornicy impulsowej. Nawet jeśli średnia wartość napięcia zasilania jest poprawna i w miarę stała, to wysokoczęstotliwościowe „śmieci” potrafią przebić się przez niedoskonałe PSRR i modulować wyniki pomiarów czy też „przesączać się” na wyjście przetwornika cyfrowo-analogowego. Doskonałą ilustracją przebiegu PSRR w funkcji częstotliwości jest rysunek 23, zaczerpnięty z noty katalogowej układów z serii REF50xxEI. Jak na dłoni widać wszystkie składowe, które wynikają zarówno z efektów pasożytniczych, jak i z niedoskonałości samego układu. W niższym przedziale pasma, czyli do około 1 kHz, PSRR jest dość wysoki i wynosi początkowo ponad 110 dB, spadając do 100 dB przy 1 kHz. Potem krzywe zaczynają się od siebie oddalać, przy czym największa różnica jest widoczna przy częstotliwościach kilkunastu kiloherców. W tym obszarze możliwości źródła „walczą” jeszcze ze spadającą powoli skutecznością działania kondensatorów, które coraz gorzej radzą sobie ze składowymi wysokoczęstotliwościowymi. Gdy w miarę wzrostu częstotliwości wahań napięcia zasilającego sam układ przestaje skutecznie tłumić te zmiany, a w kondensatorach zaczyna dochodzić do głosu szeregowa indukcyjność, krzywe znów zaczynają się na siebie nakładać, razem spadając do zaledwie 50 dB w rejonie częstotliwości 1 MHz. Nietrudno się domyślić, że dalej może być już tylko gorzej.

W praktyce trzeba zapamiętać prostą zasadę: źródła odniesienia nie należy traktować jak zwykłego „trzypinowego scalaka”. Jeśli zasilanie pochodzi z przetwornicy, bardzo często warto dodać filtr RC lub nawet LC o umiarkowanej dobroci, a jeszcze lepiej – osobny, niskoszumny stabilizator LDO (o wysokim PSRR) poprzedzający źródło. Zysk bywa większy niż wymiana samego wzorca na model o nieco lepszym TC czy niższych szumach własnych. Trzeba przy tym uważać, aby nie dodawać elementów, które wniosą własny dryf, szum albo spadek napięcia, uniemożliwiający poprawną pracę przy niskim napięciu wejściowym.

Kolejnym parametrem, który znów można łatwo wyjaśnić poprzez analogię do stabilizatorów, jest napięcie dropout lub minimalny zapas wejście-wyjście. W źródłach szeregowych zwykle trzeba zapewnić zasilanie o wartości przekraczającej o przynajmniej kilkaset miliwoltów nominalne napięcie wyjściowe, choć dokładne wymogi zależą od rodzaju układu, prądu wyjściowego i temperatury. Przykładowo ADR45xx oferuje dropout rzędu 300 mV przy 2 mA obciążenia (w wersjach o napięciu wyjściowym powyżej 3 V). Takie osiągi okazują się bardzo pomocne w przypadku systemów 3,3-woltowych z referencją 2,5 V, ale mogą okazać się niewystarczające przy zasilaniu układu napięciem 3,0 V i referencji o napięciu wyjściowym 2,8 V. Niby drobiazg, ale w realnym projekcie może on zadecydować o tym, czy parametry katalogowe będą w ogóle osiągalne.

Uwagę należy poświęcić także poborowi prądu. W sprzęcie sieciowym ma on zwykle znaczenie drugorzędne, ale w urządzeniach bateryjnych bywa czynnikiem krytycznym – każdy mikroamper dodany do bilansu energetycznego skraca czas pracy urządzenia na baterii lub akumulatorze. Jak już wspomniano wcześniej, na tym polu świetnie wypadają niektóre nowoczesne źródła napięcia odniesienia typu bandgap i rozwiązania floating-gate. Dlatego w węzłach IoT, sensorach o długim czasie czuwania czy układach zasilanych energią odzyskaną z otoczenia (ang. energy harvesting) lepszy bywa nie „najdokładniejszy” wzorzec, lecz taki, który daje rozsądny kompromis między współczynnikiem temperaturowym, szumem i poborem prądu. Należy przy tym pamiętać, że w przypadku źródeł szeregowych parametr ten jest zwykle podawany dla układu nieobciążonego – w realnych warunkach, o ile źródło nie będzie współpracowało jedynie z wejściami o wysokiej impedancji, np. JFET (a taki scenariusz nie jest raczej zbyt często spotykany), zawsze trzeba będzie uwzględnić jeszcze jego prąd wyjściowy.

Wspomniane już we wcześniejszej części tego artykułu układy ISL21080 o poborze prądu na poziomie 310 nA (maksymalnie do 1,5 μA) należą do ścisłej czołówki pod względem energooszczędności, warto jednak pamiętać, że inni producenci także nie próżnują w tym obszarze rynku. Firma Texas Instruments opracowała serię REF35, która może poszczycić się dokładnością bazową 0,05%, maksymalnym dryfem termicznym na poziomie 10...12 ppm/°C i szumem w paśmie niskoczęstotliwościowym rzędu 3,3 ppm pk-pk – a to wszystko przy typowym poborze prądu zaledwie 650 nA. Stabilność obciążeniowa wynosi 20 ppm/mA, co w przypadku urządzeń ultra low-power (w których wszystkie prądy i tak są redukowane do absolutnego minimum) także jest wartością w zupełności wystarczającą. Układy REF35 są dostępne w wersjach o napięciu znamionowym 1,024 V, 1,2 V, 1,25 V, 1,6 V, 1,8 V, 2,048 V, 2,5 V, 3,0 V, 3,3 V, 4,096 V oraz 5,0 V i mogą być zasilane napięciem do 6 V.

A skoro jesteśmy już przy wartości napięcia wyjściowego, to zatrzymajmy się tu na chwilę i pomyślmy, skąd właściwie biorą się poszczególne liczby opisujące ten parametr. Historycznie wiele referencji występowało w „magicznych” wartościach: 1,225 V, 2,048 V, 2,5 V, 4,096 V, 5,0 V, 10 V, które zdecydowanie nie były i nie są przypadkowe. Napięcia 1,225 V oraz zbliżone (np. 1,2 V) to wartości typowe dla klasycznego bandgapu, czyli związane z właściwościami półprzewodnika krzemowego. Z kolei napięcia typu 2,048 V czy 4,096 V dobrze współgrają z binarnym przeliczaniem w systemach pomiarowych – nietrudno zauważyć, że jeżeli 12-bitowy przetwornik pracuje z VREF=2,048 V, to na jeden kwant przypada dokładnie 0,5 mV, zaś przy VREF=4,096 V jeden najmłodszy bit reprezentuje dokładnie 1 mV. Taka wartość VREF znakomicie ułatwia dokładne przeliczanie kodu wyjściowego ADC (lub wejściowego kodu DAC) na konkretne napięcie, bez ryzyka występowania błędów zaokrągleń, które nieuchronnie pojawiłyby się przy zastosowaniu bardziej „okrągłych” liczb, np. 2,5 V czy 4,0 V.

Źródła o napięciu znamionowym 5,0 V są z kolei wygodne w użyciu z wieloma przetwornikami ADC, które pracują w systemach 5-woltowych, umożliwiają bowiem pełne wykorzystanie zakresu napięć wejściowych przetwornika – możliwe jest np. zasilanie mikrokontrolera za pomocą zwykłego stabilizatora 5-woltowego, podczas gdy jego wewnętrzny przetwornik ADC pracuje pod takim samym napięciem, ale już zdecydowanie lepiej stabilizowanym i niskoszumnym. Warto w tym miejscu dodać, że w podobnych sytuacjach trzeba zawsze uwzględnić warunki brzegowe, sprawdzając czy w przypadku wystąpienia maksymalnej możliwej różnicy pomiędzy zasilaniem domeny cyfrowej (VDD), a napięciem części analogowej (VDDA/VREF) nie dojdzie do uszkodzenia mikrokontrolera. A nawet jeśli różnica będzie pozornie niewielka, należy zweryfikować, czy układ nie będzie pracował poza dopuszczalnym (albo zalecanym) zakresem parametrów.

Napięcia odniesienia rzędu 10 V długo pozostawały standardem w aparaturze kalibracyjnej. Wartość wyjściowa decyduje jednak nie tylko o pełnej skali, lecz także o bezwzględnej wartości szumu i dryfu dla tej samej liczby ppm określonej w nocie katalogowej układu.

Niekiedy lepiej jest zatem zastosować referencję 4,096 V i buforowany dzielnik napięciowy blisko odbiornika niż na siłę dobierać źródło 10-woltowe, które może okazać się gorsze w danym zastosowaniu (np. z uwagi na wyższy pobór prądu, słabą dostępność czy wysoką cenę).

Wybierając scalone źródło VREF trzeba też zwracać uwagę na dopuszczalne wartości prądu wyjściowego w obydwu kierunkach, tj. gdy źródło oddaje prąd do obciążenia (ang. source) lub go z niego pobiera (ang. sink). Wiele wejść referencyjnych ADC pobiera ładunek impulsowo, z kolei część przetworników DAC potrafi w pewnych warunkach oddać niewielki prąd z powrotem do źródła. Układ zdolny jedynie do „źródłowania” może wtedy wymagać dodatkowego bufora. Właśnie dlatego producenci podkreślają w danych katalogowych zdolność układu do pracy w trybie source/sink np. na ±10 mA, choć czasem parametry zalecane (a także wyjściowe prądy zwarciowe) różnią się w zależności od kierunku tego prądu. Tak jest np. w przypadku wspomnianej rodziny REF35, która ma zalecane wartości prądu wyjściowego w zakresie +10 mA (source)/–5 mA (sink), zaś prądy zwarciowe to odpowiednio 33 mA i –21 mA. Choć może się to wydawać mało istotnym szczegółem, to w specyficznych sytuacjach taka informacja jest nieraz ważniejsza od różnicy między 3 ppm/°C a 2 ppm/°C.

A zatem – co wybrać w praktyce?

Przyjrzyjmy się kilku reprezentatywnym przykładom, podsumowując niejako dotychczasowe rozważania. Dla aparatury laboratoryjnej i systemów o nacisku położonym na stabilność długoterminową dobrym reprezentantem szkoły klasycznej jest wspomniany LT1021: źródło typu buried Zener, niski poziom szumów, wysoki PSRR i doskonała stabilność, ale także wyższe napięcie pracy i większy pobór prądu. Dla nowoczesnych systemów 2,5 V/3,3 V, w których liczy się niski szum i mały dryf przy umiarkowanym poborze prądu, bardzo sensownym wyborem okaże się np. ADR4525 lub pokrewne warianty ADR45xx: 0,02% błędu początkowego, stabilność temperaturowa dochodząca do 2 ppm/°C w klasie B oraz 0,8 ppm/°C w klasie D, szum około 1 μVpp w paśmie 0,1 Hz...10 Hz oraz nienajgorszy prąd zasilania (nieco poniżej 1 mA). Gdy potrzeba szerokiego zakresu zasilania, dobrej wydajności i wysokiej precyzji w zastosowaniach przemysłowych lub medycznych, mocnym kandydatem jest REF50xx, a szczególnie jego nowsze odmiany określane jako enhanced-grade, z dryfem do 2,5 ppm/°C, dokładnością 0,025%, niskim szumem i stabilnością długoterminową 22 ppm/1000 h. Natomiast tam, gdzie ważniejszy jest stosunkowo niewielki pobór prądu i niski koszt, można sięgnąć po prostsze referencje bandgap; przykładowo Microchip wprowadził na rynek układ MCP1501 – buforowane źródło zdolne do pracy z prądem wyjściowym ±20 mA, z dokładnością bazową 0,1% i maksymalnym TC równym 50 ppm/°C (typowo 10 ppm/°C). Wprawdzie nie jest to układ do 24-bitowego mostka pomiarowego, ale w bardzo wielu praktycznych konstrukcjach okaże się w zupełności wystarczający.

Jeszcze ciekawszym przykładem nowoczesnego bandgapu klasy premium jest wspomniany na początku artykułu LTC6655. Jak to zwykle bywa w przypadku układów scalonych, których oznaczenie zaczyna się od liter „LTC” (spuścizna po firmie Linear Technology, przejętej niecałą dekadę temu przez ADI), nie jest to układ najtańszy – w detalu jego koszt zaczyna się od ponad 60 złotych. Jest to jednak układ bardzo dokładny i stabilny: dryf maksymalny to 2 ppm/°C, dokładność bazowa wynosi ±0,025%, zaś poziom szumu to zaledwie 0,25 ppm pk-pk w dolnym paśmie częstotliwości.

Technikalia

Co ważne, montaż i prowadzenie ścieżek są w zastosowaniach praktycznych równie ważne jak parametry katalogowe. Literatura dotycząca tematu źródeł napięcia odniesienia szczegółowo omawia wpływ naprężeń płytki, upływności powierzchni, orientacji montażu, a nawet nacinania laminatu wokół wzorca, na wynikową dokładność i stabilność. W układach o rozdzielczości 16 bitów i wyższej nie są to akademickie subtelności, ale realne problemy, które trzeba uwzględnić w projekcie PCB. Pozostałości topnika, wilgoć, zabrudzenia czy zbyt blisko przebiegająca ścieżka przenosząca szybkozmienne sygnały cyfrowe, mogą wprowadzać błędy większe niż różnica między dwoma klasami dokładności tego samego układu. Dobra praktyka jest następująca: wzorzec napięcia należy umieścić możliwie blisko odbiornika, z dala od źródeł ciepła (np. radiatorów, obwodów zasilających czy tranzystorów kluczujących dużej mocy) i ścieżek impulsowych. Trzeba zapewnić pełną, czystą masę analogową o niskiej impedancji (najlepiej w postaci wewnętrznej płaszczyzny masy nienaruszonej żadnymi ścieżkami), krótkie podłączenie do wejść współpracujących układów (np. pinu VREF przetwornika), dedykowane odsprzęganie przy samym układzie i brak wymuszonych naprężeń przenoszących się z mocowania PCB w obudowie czy też dużych, ciężkich elementów (np. transformatorów) montowanych na samej płytce drukowanej.

Warto również pamiętać, że napięcie odniesienia nie powinno zasilać „po drodze” niczego, co nie jest bezwzględnie konieczne. Pokusa, by z precyzyjnej referencji pobrać jeszcze niewielki prąd dla dzielnika, potencjometru wieloobrotowego czy wskaźnika, zwykle kończy się zwiększeniem błędu. Jeżeli ze źródła trzeba wygenerować niestandardowy poziom napięcia, lepiej zastosować stabilny dzielnik z rezystorów o niskim TC i bufor o bardzo niskim i stabilnym napięciu niezrównoważenia oraz małym prądzie polaryzacji. Każdy dodatkowy rezystor, wzmacniacz i punkt lutowniczy staje się bowiem niejako elementem całego wzorca. Long story short: źródło napięcia odniesienia to nie precyzyjny stabilizator, nie „podwieszajmy” więc do niego niczego, co nie jest absolutnie konieczne do prawidłowego działania toru analogowego.

Podsumowanie

Powyższy materiał nie wyczerpuje wprawdzie tematyki źródeł napięcia odniesienia, stanowi jednak solidną podbudowę do świadomego stosowania tego rodzaju układów. Producenci co chwila kuszą nas atrakcyjnymi parametrami – doskonałą stabilnością, bardzo precyzyjną kalibracją fabryczną czy też ultraniskim poborem prądu. Wybór jest spory, a na pewno nieporównanie lepszy niż jeszcze 10 czy 20 lat temu.

W praktyce nie należy jednak wybierać wzorca napięcia wyłącznie na podstawie jednej tabelki porównawczej. Jeżeli system pracuje z przetwornikiem SAR, trzeba sprawdzić odpowiedź na impulsy prądu i zalecany kondensator wyjściowy. Jeżeli urządzenie jest zasilane z przetwornicy impulsowej, trzeba ocenić PSRR w funkcji częstotliwości i zaprojektować stosowną filtrację zasilania. Jeżeli sprzęt będzie w czasie eksploatacji poddawany intensywnym cyklom temperaturowym, należy zwrócić uwagę nie tylko na TC, ale też na histerezę termiczną. Jeżeli urządzenie ma działać latami bez kalibracji, istotniejsza od początkowego 0,01% może okazać się stabilność po 1000 i 5000 godzin. A jeśli cały układ jest zasilany bateryjnie, pobór własny referencji potrafi zdominować bilans energii szybciej niż dodatkowy wzmacniacz operacyjny czy nieco lepszej klasy przetwornik.

Źródło napięcia odniesienia nie jest więc drobnym elementem pomocniczym. Parafrazując powiedzenie dyrektora Wardowskiego z kultowego „Czterdziestolatka”: „Jeżeli kręgosłup jest krzywy, cały organizm jest garbaty” możemy stwierdzić, że: „Jeżeli wzorzec jest byle jaki, to cały układ także.” W dobrze zaprojektowanym systemie źródło napięcia odniesienia jest jednym z podstawowych bloków funkcjonalnych, który należy traktować z taką samą uwagą jak wzmacniacz pomiarowy, przetwornik czy filtry analogowe. Konstruktor, który dokładnie rozumie różnice między hasłami takimi jak: dokładność bazowa, dryf, szum, histereza, czy stabilność długoczasowa, a także bezbłędnie rozróżnia pojęcia load regulation, line regulation i PSRR, rzadziej ulega marketingowym skrótom i łatwiej wybiera układ rzeczywiście adekwatny do opracowywanego projektu. A to zwykle oznacza mniej niespodzianek na etapie uruchamiania, łatwiejszą kalibrację i... wyniki pomiarów, którym można zaufać.

inż. Przemysław Musz, EP

Zaloguj

Zaloguj