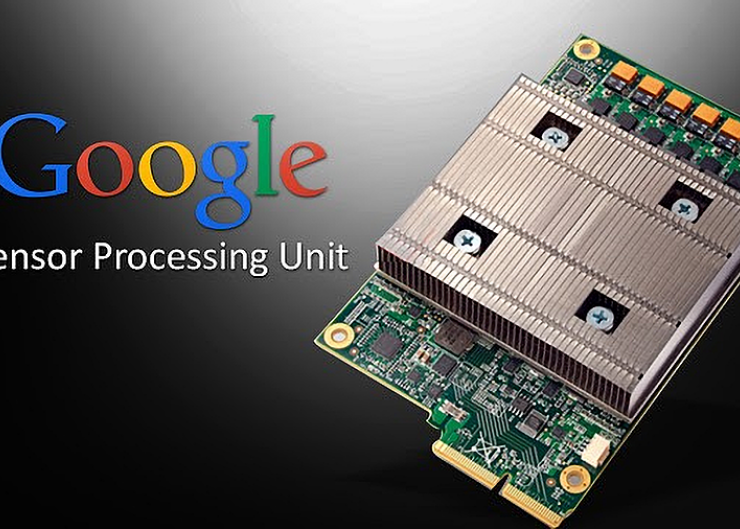

Występuje w nim słowo "tensor" pochodzi od nazwy biblioteki TensorFlow (także opracowanej przez tę firmę), pod której potrzeby układ ten został zaprojektowany (tym samym nie jest to dosłownie jednostka tensorowa, co uwzględnia przedstawione na początku tłumaczenie oryginalnej nazwy pojęcia). Samo TPU natomiast to zbiór kolejek FIFO przechowujących wartości wag neuronów, tzw. rejestrów jednolitych (Unified Buffers) przechowujących wartości wejść i wyjść neuronów, jednostek macierzowych MMU (Matrix Multiply Unit), w których następuje mnożenie wag neuronów przez ich wartości wejściowe i/lub wyjściowe oraz sumowanie wyników tak dokonanych mnożeń, rejestrów pełniących rolę akumulatorów przechowujących bieżące wyniki MMU oraz jednostek aktywacyjnych (Activation Unit), w których następuje realizacja funkcji aktywacji neuronów (więcej informacji można znaleźć tutaj: http://bit.ly/2YGDJdA i tutaj: http://bit.ly/30gpsEQ). Zgodnie z dostępnymi danymi, tego rodzaju układ jest do 30 razy szybszy (w sensie liczby operacji wykonywanych w ciągu sekundy) od układu CPU i GPU użytego do tego samego celu.

Sieci neuronowe to jednostka przetwarzająca

26 lipca 2019

Niewątpliwie terminy CPU (Central Processing Unit - centralna jednostka przetwarzająca) i GPU (Graphics Processing Unit - graficzna jednostka przetwarzająca) są znane każdemu kto miał do czynienia z komputerami, a zwłaszcza z ich procesorami i kartami graficznymi. Jednak, obok nich, występuje również od niedawna termin TPU (Tensor Processing Unit - jednostka przetwarzająca Tensor) oznaczający elektroniczny układ/zestaw specjalizowany, przeznaczony dla sieci neuronowych i związanego z nimi uczenia maszynowego. Pojęcie to wymyślone zostało w maju 2016 roku przez firmę Google, która pochwaliła się wówczas opracowaniem pierwszego w świecie tego rodzaju układu, i zastosowała go w swoich centrach danych.

Zobacz więcej w kategorii Nowe produkty

Zaloguj

Zaloguj